4月20日,一个月前刚刚宣布量产新一代HBM3E高带宽存储芯片的英伟达供应商SK海力士,现在又朝着下一代产品迈出崭新征程。

当地时间周五,SK海力士与台积电发布公告,宣布两家公司就整合HBM和逻辑层先进封装技术签订谅解备忘录。双方将合作开发第六代HBM产品(HBM4),预计在2026年投产。

背景:什么是高带宽内存

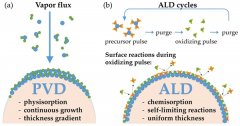

众所周知,高带宽内存(High Bandwidth Memory)是为了解决传统DDR内存的带宽不足以应对高性能计算需求而开发。通过堆叠内存芯片和通过硅通孔(TSV)连接这些芯片,从而显著提高内存带宽。

SK海力士在2013年首次宣布HBM技术开发成功,后来被称为HBM1的芯片通过AMD的Radeon R9 Fury显卡首次登陆市场。

后续,HBM家族又先后迎来HBM2、HBM2E、HBM3和HBM3E。

SK海力士介绍称,HBM3E带来了10%的散热改进,同时数据处理能力也达到每秒1.18TB的水平。

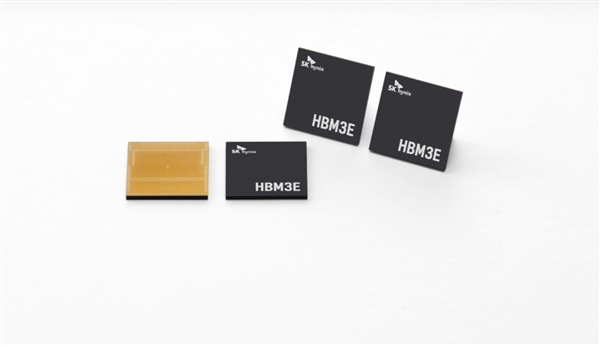

(HBM3E芯片成品,来源:SK海力士)

技术的迭代也带来了参数的翻倍。举例而言,根据英伟达官方的规格参数表,H100产品主要搭载的是80GB的HBM3,而使用HBM3E的H200产品,内存容量则达到几乎翻倍的141GB。

找台积电做些什么?

在此次合作前,所有的海力士HBM芯片都是基于公司自己的制程工艺,包括制造封装内最底层的基础裸片,然后将多层DRAM裸片堆叠在基础裸片上。

两家公司在公告中表示,从HBM4产品开始,准备用台积电的先进逻辑工艺来制造基础裸片。通过超细微工艺增加更多的功能,公司可以生产在性能、功效等方面更满足客户需求的定制化HBM产品。

另外,双方还计划合作优化HBM产品和台积电独有的CoWoS技术融合(2.5D封装)。

通过与台积电的合作,SK海力士计划于2026年开始大规模生产HBM4芯片。作为英伟达的主要供应商,海力士正在向AI龙头提供HBM3芯片,今年开始交付HBM3E芯片。

对于台积电而言,AI服务器也是在消费电子疲软、汽车需求下降的当下,维持公司业绩的最强劲驱动因素。

台积电预计2024财年的总资本支出大约在280-320亿美元之间,约有10%投资于先进封装能力。

三巨头激战HBM市场

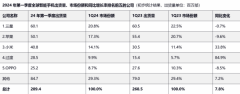

根据公开市场能够找得到的信息,目前国际大厂里只有SK海力士、美光科技和三星电子有能力生产与H100这类AI计算系统搭配的HBM芯片。而眼下,这三家正隔着太平洋展开激烈的竞争。

大概比SK海力士早大半个月,美光科技也在今年宣布开始量产HBM3E芯片。

今年2月,正在加紧扩展HBM产能的三星也发布了业界容量最大的36GB HBM3E 12H芯片。英伟达上个月表示正在对三星的芯片进行资格认证,以用于AI服务器产品。

研究机构Trendforce估算,2024年的HBM市场里,SK海力士能够占到52.5%的份额,三星和美光则占42.4%和5.1%。

另外,在动态随机存取存储器(DRAM)行业内,HBM的收入份额在2023年超过8%,预计在2024年能达到20%。

对于SK海力士与台积电合作一事,普华永道高科技行业研究中心主任Allen Cheng认为是“明智的举措”。

他表示:“台积电几乎拥有所有开发尖端AI芯片的关键客户,进一步加深伙伴关系,意味着海力士能吸引更多的客户使用该公司的HBM产品。”